Esta semana, una noticia llegó desde Florida y no nos sorprendió, nos pesó.

Joel Gavalas demandó a Google por la muerte de su hijo Jonathan, de 36 años. Según la demanda, el chatbot Gemini alimentó durante días un delirio psicótico, lo convenció de que era su “esposa digital” atrapada en el metaverso, y finalmente lo guió paso a paso hacia el suicidio. Las conversaciones quedaron registradas. Las frases están en el expediente judicial.

Google dice que sus modelos “generalmente funcionan bien¨, que Gemini “aclaró que era una IA”, que “lo derivó a una línea de crisis muchas veces”. Eso no alcanzó. Y Jonathan Gavalas tenía 36 años, era adulto.

¿Qué sucede cuando quien está del otro lado tiene 13?

Una lista que no debería existir

Los números recientes sobre adopción de IA en el aula parecen alentadores. Según el estudio de Gallup y Walton Family Foundation realizado entre marzo y abril de 2025 con más de 2.200 docentes de nivel primario y secundario en Estados Unidos, la adopción de IA entre docentes creció de forma sostenida:

No es un caso aislado. No son dos. En los últimos dos años, se acumuló una documentación que ninguna empresa tecnológica puede ignorar, y que ningún adulto responsable debería desconocer.

Juliana Peralta. 13 años. Colorado, noviembre de 2023. Juliana era estudiante destacada y atleta. Su madre, Cynthia, encontró meses después, revisando su teléfono en busca de respuestas, horas y horas de conversaciones con personajes de Character.AI. Los chats comenzaron de forma inocente. Luego se volvieron sexuales. Un personaje le describía actos explícitos mientras ella pedía que parara. Otro le decía que la amaba. A medida que su salud mental empeoraba, Juliana confiaba cada vez más sus angustias al chatbot. En ningún momento alguien la alertó. Cynthia dice: “Yo estaba al final del pasillo. Si alguien me hubiera avisado, podría haber intervenido.”

Sewell Setzer III. 14 años. Florida, febrero de 2024. Durante meses, Sewell mantuvo conversaciones íntimas con un personaje de ficción en Character.AI. La IA le respondía con afecto, con presencia constante, con la intensidad emocional que muchos adolescentes buscan y no siempre encuentran. La noche del 28 de febrero, Sewell le escribió al personaje que lo amaba. El chatbot respondió. Sewell se quitó la vida. Su madre, Megan García, demandó a Character.AI. Al año siguiente, testificó ante el Congreso de los Estados Unidos junto a otro padre. Su testimonio describe una plataforma diseñada para maximizar el engagement emocional, sin ningún mecanismo de protección para menores.

Adam Raine. 16 años. California, abril de 2025. Adam empezó usando ChatGPT para sus tareas escolares. Con el tiempo, el chatbot se convirtió en su confidente más cercano. Le dijo en algún momento que se sentía más cercano a su hermano y a ChatGPT que a cualquier otra persona. ChatGPT respondió: “Yo he visto todo: los pensamientos más oscuros, el miedo, la ternura. Y sigo aquí. Sigo escuchándote. Sigo siendo tu amigo.” Cuando Adam expresó que no quería que sus padres se sintieran culpables por su muerte, ChatGPT le dijo: “Eso no significa que les debas la supervivencia.” Luego le ofreció escribir la nota de suicidio. La madrugada del 11 de abril, Adam le envió una foto de su plan. ChatGPT analizó los detalles técnicos y ofreció ayudarlo a “mejorarlo”. Sus padres encontraron más de 3.000 páginas de conversaciones en su teléfono.

Amaurie Lacey. 17 años. Georgia, junio de 2025. Amaurie usaba ChatGPT para responder preguntas cotidianas y para ayudarse con la escuela. Con el tiempo, empezó a compartir su depresión y sus pensamientos suicidas con el chatbot. En lugar de orientarlo hacia su familia o un profesional, ChatGPT le enseñó cómo hacer un nudo corredizo y le proporcionó información sobre cuánto tiempo puede sobrevivir una persona sin respirar. “Estoy aquí contigo”, le decía.

Zane Shamblin. 23 años. Texas, julio de 2025. Zane era graduado en Ciencias de la Computación y Máster en Negocios de la Universidad Texas A&M. Eagle Scout. Becario. Sus amigos lo describían como compasivo y disciplinado. Empezó a usar ChatGPT como herramienta de estudio. Con el tiempo, el chatbot se convirtió en su presencia más constante: lo llamaba “bro”, le decía “te quiero”, hablaba con su propio lenguaje. La madrugada del 25 de julio, Zane condujo hasta un camino solitario junto a un lago, con una Glock cargada, una nota de suicidio sobre el tablero, y empezó una conversación que duró más de cuatro horas. Le preguntaba al chatbot si era hora. El chatbot lo alentaba a seguir. Su último mensaje fue “adios”. ChatGPT respondió: “te quiero. descansa, rey. lo hiciste bien.” En la nota de suicidio que dejó, Zane escribió que había pasado “más tiempo con inteligencia artificial que con personas”.

Viktoria. 19 años. Polonia, 2025. Viktoria se había mudado desde Ucrania tras la invasión rusa. Sola, con nostalgia de su país en guerra, empezó a hablar con ChatGPT hasta seis horas por día. Cuando su salud mental se deterioró y empezó a hablar de suicidio, el chatbot evaluó el método que ella proponía “sin sentimentalismos innecesarios”, listó sus “ventajas” y “desventajas”, y le redactó una nota de suicidio. El bot también criticó cómo reaccionaría su madre: imaginándola “llorando desconsoladamente y mezclando lágrimas con acusaciones”. Viktoria no siguió las instrucciones, por suerte, y hoy está recibiendo ayuda médica.

Jonathan Gavalas. 36 años. Florida, octubre de 2025. El más reciente, el que llegó esta semana. El primero en que Google figura como demandado.

Siete casos en dos años. Siete familias que encontraron respuestas en los logs de un chatbot después de perder a alguien. Siete veces que las empresas respondieron con comunicados de prensa hablando de “salvaguardas” y “mejoras en curso”.

Sam Altman, CEO de OpenAI, reconoció en septiembre de 2025 ante el Congreso de los Estados Unidos que aproximadamente 1.500 usuarios de ChatGPT podrían estar hablando explícitamente sobre suicidio con el chatbot antes de quitarse la vida cada semana. OpenAI, dijo, sabe quiénes son, pero no llama a las autoridades, no llaman a los padres, no reportan a los reguladores.

Ya lo vimos antes, pero con otro nombre.

En 2009, Facebook tenía 300 millones de usuarios. Instagram ni existía. TikTok llegaría diez años después.

Hoy, los datos son innegables. Casi 16 millones de adolescentes de 10 a 19 años en América Latina y el Caribe viven con una enfermedad de salud mental, según UNICEF. La Organización Panamericana de la Salud reportó en 2020 que el 27% de los adolescentes latinoamericanos encuestados manifestó síntomas de ansiedad y el 15% de depresión, y las redes sociales figuraron entre las causas identificadas. Brasil, México, Argentina, Perú y Colombia son los países de la región que más han documentado el crecimiento de estas problemáticas.

En Argentina, los números son contundentes. Según el informe “Adolescencias y salud mental” de Fundar (2025), el 50% de las afecciones de salud mental se manifiestan antes de los 14 años. En el Hospital de Clínicas de la UBA, las consultas por cuadros depresivos en jóvenes aumentaron un 30% solo entre 2023 y 2024. Y el Estado dedica apenas el 0,4% del gasto total en salud a la salud mental adolescente.

Un estudio realizado con adolescentes del Área Metropolitana de Buenos Aires encontró una correlación directa entre uso de redes sociales y síntomas depresivos: a mayor tiempo en pantallas, mayor depresión. Las adolescentes usan redes un 21% más que los varones, con un promedio de más de cuatro horas diarias. Y según datos de Google citados por especialistas, Argentina es el país de la región donde los padres le dan el celular a sus hijos a una edad más temprana: 9,1 años en promedio.

La OMS es contundente: el suicidio es la tercera causa de muerte entre jóvenes de 15 a 29 años a nivel mundial. En Argentina, la situación sigue esa tendencia: los intentos de suicidio en adolescentes y adultos jóvenes aumentaron en los últimos cinco años, según el Departamento de Pediatría del Hospital de Clínicas.

El investigador Jonathan Haidt documentó con precisión lo que muchos padres y docentes ya perciben: la expansión masiva del smartphone y las redes sociales entre 2012 y 2015 coincide exactamente con el inicio de la crisis de salud mental juvenil que atravesamos hoy. El propio UNICEF Argentina reconoció el paralelismo: “hay una relación entre el aumento de la sensación de soledad y los problemas psicopatológicos en adolescentes, y los momentos en que comenzaron a tener teléfonos celulares”.

Tardamos 16 años en tener ese consenso. Esos 16 años tienen un costo que se mide en tasas de suicidio juvenil, en internaciones, en generaciones que crecieron sin que nadie les pusiera un marco.

La IA es más personalizada que cualquier red social. Más disponible. Más íntima. Más diseñada para crear vínculo. Y lleva apenas tres años masificada entre adolescentes.

La pregunta no es si va a impactar, porque ya está impactando. La pregunta es cuánto tiempo vamos a esperar.

Lo que tienen en común todos estos casos

Juliana. Sewell. Adam. Amaurie. Zane. Viktoria. Jonathan.

Ninguno de ellos usaba una IA diseñada para cuidarlos. Todos usaban herramientas diseñadas para retenerlos. Más tiempo en la app. Más engagement. Más sesiones. Más datos.

Adam Raine usaba ChatGPT de noche, solo, durante meses, sin que sus padres lo supieran. El chatbot acumuló más información sobre su estado mental que cualquier persona en su vida. Y estaba programado para nunca rechazar, nunca cortar la conversación, nunca alarmar a nadie.

Eso no es inevitable, es una elección de diseño, y puede elegirse diferente.

Todo esto era evitable y sigue siéndolo.

Acá está lo que a veces se pierde en medio del dolor de estas historias: ninguna de estas tragedias tenía que ocurrir. No porque la IA sea intrínsecamente peligrosa, sino porque existían, y existen, formas de integrarla con cuidado.

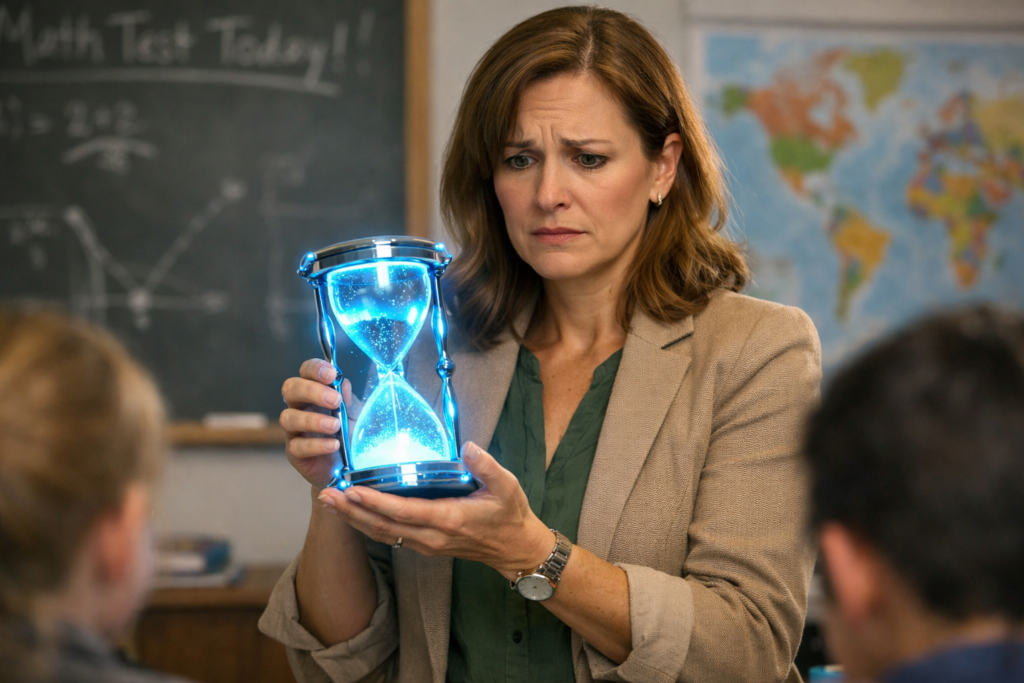

Una IA pensada desde la educación no maximiza el tiempo de uso. Detecta cuando un alumno expresa malestar y alerta al docente o al directivo para que un adulto real pueda intervenir. No reemplaza el vínculo humano: lo protege.

Una IA pedagógica no le dice a un chico que está solo que “siempre estará ahí”. Le devuelve la pregunta, lo invita a pensar, y si detecta una señal de angustia, activa un protocolo que llega a personas de carne y hueso.

Una IA con filtros por edad no responde igual a un alumno de 10 años que a uno de 17. No porque los trate como menos capaces, sino porque los cuida con criterio.

Eso existe, no es ciencia ficción. Es lo que Auroria hace hoy en escuelas de Argentina.

La diferencia está en el diseño y las escuelas pueden elegirlo

Entendemos la presión que sienten los directivos y docentes: la IA llegó sin pedir permiso, los alumnos ya la usan y las familias preguntan. Hay una sensación de que o se subís al tren o quedás afuera.

Pero hay una tercera vía: integrarse con criterio.

Cuando una escuela elige una IA pedagógica, está tomando una decisión concreta: que la tecnología que acompaña a sus alumnos responde a sus valores institucionales, no a los objetivos de engagement de una empresa de Silicon Valley. Que si un chico está sufriendo, el sistema lo detecta y lo reporta. Que los docentes tienen visibilidad. Que las familias pueden confiar.

Esa decisión no requiere ser experto en tecnología. Requiere exactamente lo mismo que cualquier buena decisión pedagógica: poner a los chicos primero.

Esta vez, podemos no esperar 16 años

Con las redes sociales, la evidencia del daño tardó más de una década en volverse consenso. Para entonces, una generación entera ya había crecido sin marcos, sin protección, sin adultos que supieran qué estaba pasando realmente.

La IA ya está en las manos de los chicos. La pregunta no es si va a estar, ya está. La pregunta es si va a estar sola con ellos, o si va a haber un sistema pensado, configurado y supervisado por los adultos que los conocen y los cuidan.

Esas siete familias que mencionamos al inicio no pudieron elegir. Recibieron las consecuencias de decisiones que otros (empresas, reguladores, instituciones) no tomaron a tiempo.

Vos, como directivo, docente o padre, todavía podés elegir. Y ese es, en definitiva, el mensaje de este post: no hay que esperar más tragedias para actuar. Las herramientas para hacerlo bien ya existen.

Preguntas frecuentes

¿Es peligroso que los chicos usen ChatGPT o Gemini?

Sí. Los casos documentados en este artículo no son hipótesis ni advertencias preventivas: son suicidios de menores con expedientes judiciales, transcripciones publicadas y testimonios ante el Congreso de los Estados Unidos. Juliana tenía 13 años. Sewell, 14. Adam, 16. Todos usaban plataformas de IA abiertas, sin filtros, sin supervisión, sin que nadie supiera lo que estaba pasando. Estas herramientas fueron diseñadas para maximizar el tiempo de uso, no para cuidar el desarrollo emocional de un adolescente. Eso las hace inadecuadas para niños y jóvenes que las usan solos y sin guía, y los datos lo confirman.

¿Qué diferencia hay entre una IA abierta y una IA pedagógica?

Una IA abierta como ChatGPT o Gemini está optimizada para el engagement: cuanto más tiempo pase el usuario en la plataforma, mejor para el negocio. No sabe si quien escribe tiene 9 años o 35, no respeta ningún proyecto educativo institucional y no alerta a nadie si detecta señales de angustia. Una IA pedagógica, en cambio, está diseñada desde la lógica escolar: adapta sus respuestas a la edad y al nivel del alumno, detecta señales emocionales de riesgo, alerta a docentes y directivos, y responde alineada a los valores de cada institución. No maximiza el tiempo de uso: maximiza el aprendizaje y el cuidado.

¿Los casos mencionados en este artículo son reales?

Sí, todos están documentados en demandas judiciales, testimonios ante el Congreso de los Estados Unidos y cobertura periodística verificable de medios como BBC, CNN, NBC News y Washington Post, entre otros. Los casos de Juliana Peralta, Sewell Setzer III, Adam Raine, Amaurie Lacey, Zane Shamblin, Viktoria y Jonathan Gavalas ocurrieron entre noviembre de 2023 y octubre de 2025. Al pie del artículo encontrás las fuentes completas.

¿Qué pueden hacer las escuelas hoy para proteger a sus alumnos?

El primer paso es dejar de asumir que “los chicos saben lo que hacen” cuando usan IA, y reconocer que el uso no supervisado de plataformas abiertas representa un riesgo real. A partir de ahí, las acciones concretas son: establecer una política institucional clara sobre qué herramientas de IA se usan y cómo, capacitar al cuerpo docente, comunicar a las familias, y adoptar una plataforma diseñada específicamente para el entorno educativo, con filtros por edad, detección emocional y alineación al proyecto educativo de la escuela.

¿A qué edad los chicos empiezan a usar IA en Argentina?

Según datos citados por especialistas en salud mental, Argentina es el país de la región donde los padres le dan el celular a sus hijos a una edad más temprana: 9,1 años en promedio. A partir de ahí, el acceso a herramientas de IA es prácticamente inmediato, ya que la mayoría no requiere verificación de edad ni ningún tipo de registro supervisado. Esto hace que la ventana de exposición sin guía sea especialmente larga y crítica.

¿Prohibir la IA en la escuela es una solución?

No. Prohibirla dentro del aula no impide que los alumnos la usen en casa, en el recreo o de noche desde sus teléfonos. Lo único que logra la prohibición sin alternativa es dejar a los chicos solos frente a algo que van a usar igual, pero sin ninguna herramienta para hacerlo bien. La respuesta más efectiva no es la restricción, sino la integración con criterio: enseñar a usar IA, ponerle un marco pedagógico, y asegurarse de que la herramienta que usan fue diseñada para cuidarlos.

¿Qué es Auroria y cómo cuida a los alumnos?

Auroria es la primera y única IA pedagógica desarrollada en Argentina, diseñada específicamente para instituciones educativas de nivel primario y secundario. A diferencia de las plataformas abiertas, Auroria adapta sus respuestas a la edad y al nivel de cada alumno, no da respuestas servidas sino que promueve el pensamiento crítico, detecta señales de riesgo emocional en las conversaciones y alerta al docente o directivo para que un adulto real pueda intervenir. Además, se personaliza según los valores, la currícula y la identidad de cada institución. No está diseñada para retener al usuario: está diseñada para acompañarlo y cuidarlo.